با ظهور هوش مصنوعی، بازتعریف ارزشها وارد مرحلهای جدید شده است؛ الگوریتمها، حتی با دقت و توان محاسباتی بالا، نمیتوانند ارزشهای انسانی و اخلاقی را در تصمیمگیری لحاظ کنند. تکیهی صرف بر الگوریتمها، میتواند به بازتولید نابرابریها منجر شود و عدالت واقعی در تخصیص منابع محدود را با چالش مواجه کند. در این نقطه «عدالت دیجیتال» و «عدالت انسانی» با هم در تضاد قرار گرفته و ضرورت بازاندیشی انسانی را آشکار میسازند. این مقاله نشان میدهد که در عصر هوش مصنوعی چگونه میتوان مانع از مغفول ماندن عدالت انسانی شد.

در جهان پیش از عصر هوش مصنوعی، هنجارها و ارزشها بر اساس تجربهی انسانی، اخلاق و عدالت اجتماعی شکل میگرفتند. در اقتصاد، شرکتها و سازمانها عمدتاً به سود و بازده مالی توجه میکردند، اما در تصمیمگیریهای خود، حداقل نوعی معیار انسانی و اخلاق حرفهای وجود داشت: وفاداری، اعتماد، توان مدیریتی و سابقهی قابل مشاهدهی انسانی و در بازار کار، ارتقا، افزایش حقوق یا تخصیص فرصتها بر اساس کیفیت کار، ابتکار، همکاری و تعهد فردی صورت میگرفت. حتی در فرهنگ و هنر، ارزشها و محبوبیت آثار تا حد زیادی بر تجربهی جمعی و قضاوت انسانی استوار بود. این دوره، گرچه ناقص و سرشار از نابرابری بود، اما عدالت انسانی و ظرفیت اخلاقی، هنوز نقش تعیینکنندهای داشت.

با ظهور هوش مصنوعی، بازتعریف ارزشها وارد مرحلهای جدید شد؛ الگوریتمها، حتی با دقت و توان محاسباتی بالا، نمیتوانند ارزشهای انسانی و اخلاقی را در تصمیمگیری لحاظ کنند. برای نمونه، یک الگوریتم مدیریت ترافیک شهری ممکن است جریان خودروها را بهطور بهینه کنترل کند و از تراکم ترافیک جلوگیری کند، اما قادر نیست اولویتبندی انسانی مانند امنیت پیادهروها، دسترسی برابر به محلههای محروم یا محافظت از گروههای آسیبپذیر را مدنظر قرار دهد. به عبارتی، الگوریتم میتواند تعداد خودروها را در جریان ترافیک مناطق کاهش دهد، اما نمیتواند تشخیص دهد کدام مسیر برای کودکان، سالمندان یا افراد کمتوان، ایمنتر است.

در حوزهی اقتصادی، الگوریتمهای بانکداری و تخصیص وام بر اساس دادههای مالی و تراکنشها تصمیم میگیرند، اما قادر نیستند ظرفیت واقعی و توان مدیریتی افراد را بسنجند. بهعنوان مثال، یک زن سرپرست خانوار که در یک منطقهی محروم کسبوکار کوچکی راهاندازی کرده است، ممکن است به دلیل کم بودن سابقهی تراکنشهای دیجیتال یا نبود دادههای کافی، واجد امتیاز پایین شناخته شده و از دریافت وام محروم شود؛ در حالی که توان اقتصادی و مدیریت او بالا است. به این ترتیب، الگوریتم، این نابرابریها را بازتولید میکند و عدالت واقعی در تخصیص منابع محدود را معلق میگذارد! در این نقطه «عدالت دیجیتال» و «عدالت انسانی» با هم در تضاد قرار گرفته و ضرورت بازاندیشی انسانی را آشکار میسازند.

«عدالت انسانی» با هم در تضاد قرار گرفته و ضرورت بازاندیشی انسانی را آشکار میسازند.

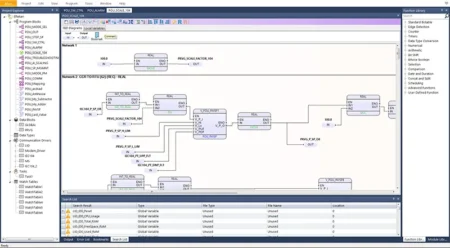

در بازار کار، الگوریتمها با رتبهبندی و امتیازدهی کارکنان، معیارهای سنتی مانند ابتکار فردی، وفاداری یا همکاری را با دادههای کمی جایگزین کردهاند. یک شرکت فناوری ممکن است زمان پاسخگویی به ایمیلها، مدت حضور در سامانهها، تعداد تعاملات داخلی و حتی فعالیت در شبکههای اجتماعی سازمانی را امتیازدهی کند. افرادی که مطابق الگوریتم عمل نکنند، ممکن است ارتقا پیدا نکنند یا قراردادشان تمدید نشود، حتی اگر کیفیت کاری و ابتکار آنها بالاتر باشد. این روند، هنجارهای انسانی و اعتماد سازمانی را کنار زده و بازتولید نابرابری در محیط کار را تسهیل میکند.

در سطح فرهنگی، الگوریتمها با هدایت تولید و مصرف محتوا، ارزشها و هنجارهای جمعی را بازتعریف میکنند.

در سطح فرهنگی، الگوریتمها با هدایت تولید و مصرف محتوا، ارزشها و هنجارهای جمعی را بازتعریف میکنند.

پلتفرمهای جهانی مانند «نتفلیکس» یا «یوتیوب» و نمونههای داخلی مانند «نماوا»، محتوا را بر اساس رفتار کاربران توصیه میکنند. تولیدکنندگان برای دیده شدن مجبورند محتوای خود را با الگوریتمها تطبیق دهند و سبکهای خلاقانه یا روایتهای اصیل کمتر مورد توجه قرار گیرند. در نتیجه، الگوریتمها به شکل غیرمستقیم ارزشهای فرهنگی را تغییر داده و تصمیمات انسانی دربارهی فرهنگ، هنر و سلیقهی عمومی را محدود میکنند.

الگوریتمها به شکل غیرمستقیم ارزشهای فرهنگی را تغییر داده و تصمیمات انسانی دربارهی فرهنگ، هنر و سلیقهی عمومی را محدود میکنند.

پیامدهای اجتماعی این بازتعریف هنجارها و ارزشها قابل توجه است. قدرت الگوریتمی، نوعی قدرت نرم ایجاد میکند که رفتار انسانی را بدون فرمان مستقیم تغییر میدهد. افراد، سازمانها و حتی دولتها، گاهی بدون آنکه متوجه باشند، رفتارهای خود را با الگوریتمها هماهنگ میکنند. نمونه این وضعیت در پلتفرمهای کاریابی دیجیتال نیز قابل مشاهده است، جایی که الگوریتمهای تطبیق رزومه و شغل، نحوهی ارائهی مهارتها و حتی ساختار CV را بازتعریف میکنند. کسانی که مطابق الگوریتم عمل نکنند، فرصتهای شغلی کمتری خواهند داشت. در سطح کلان، سازمانها و نهادهای اقتصادی بر اساس دادههای پیشبینیکننده تصمیم میگیرند که چه سرمایهگذاری مشروع، کدام محصول ارزشمند و چه رفتار اقتصادی قابل پذیرش است.

با این حال، نمیتوان محدودیتها و پیچیدگیهای ابعاد انسانی و وجودی انسان را نادیده گرفت. الگوریتمها، حتی با دقت و توان محاسباتی بسیار بالا، قادر به درک کامل عدالت، اخلاق، تجربهی انسانی و توانمندیهای فردی نیستند.

الگوریتمها، قادر به درک کامل عدالت، اخلاق، تجربهی انسانی و توانمندیهای فردی نیستند.

آنها میتوانند دادهها را تحلیل کرده و روندهای قابل اندازهگیری را شناسایی نمایند، اما نمیتوانند تشخیص دهند یک تصمیم چه اثراتی بر گروههای آسیبپذیر، روابط انسانی یا فرصتهای برابر دارد. برای مثال، یک الگوریتم ممکن است بهینهترین مسیر را در ترافیک یا سودآورترین تخصیص منابع را پیشنهاد دهد، اما نمیتواند تشخیص دهد که این تصمیم چه تأثیری بر کودکان، سالمندان یا کسبوکارهای کوچک در محلههای محروم خواهد داشت.

از این منظر، هوش مصنوعی تنها یک ابزار است و میتواند فرصتی برای بازاندیشی و بازتعریف ارزشها و هنجارها ایجاد کند، اما این فرصت زمانی معنا پیدا میکند که انسانها همچنان نقش هدایتکننده، ناظر و داور اخلاقی را حفظ کنند. به مفهوم روشنتر، هوش مصنوعی در ذات خود، ابزار محاسباتی و تحلیلی است و توانایی پیشبینی روندها و ارائه راهکارهای عددی را دارد، اما نمیتواند ارزشهای انسانی، عدالت اجتماعی و اخلاقیات را درک یا ارزیابی کند.

هوش مصنوعی در ذات خود، ابزار محاسباتی و تحلیلی است و توانایی پیشبینی روندها و ارائه راهکارهای عددی را دارد، اما نمیتواند ارزشهای انسانی، عدالت اجتماعی و اخلاقیات را درک یا ارزیابی کند.

با این حال، استفادهی هوشمندانه از این ابزار میتواند فرصتی برای بازاندیشی و بازتعریف ارزشها و هنجارها ایجاد کند. این «فرصت» به این معنا است که انسانها میتوانند با مشاهده و تحلیل خروجیهای الگوریتمی، نقاط ضعف و محدودیتهای سامانه را شناسایی کرده و معیارهای انسانی را در تصمیمگیریها بگنجانند؛ به عنوان مثال هنگامی که یک الگوریتم تخصیص وام ممکن است کسبوکارهای کوچک در محلههای محروم را به دلیل کمبود داده رد کند، بیشک این نتیجه به خودی خود منصفانه نیست، اما اگر سیاستگذاران یا مدیران انسانی دادههای الگوریتم را با آگاهی اخلاقی و اجتماعی بررسی کنند، میتوانند معیارهای عدالت را وارد فرآیند تصمیمگیری کنند و منابع را به کسانی تخصیص دهند که واقعاً به آن نیاز و البته توانمندی اقتصادی دارند. به عبارت دیگر، هوش مصنوعی خودبهخود عدالت ایجاد نمیکند، بلکه انسان میتواند با استفاده از دادههای آن، عدالت واقعی را بازتولید کند.

هوش مصنوعی خودبهخود عدالت ایجاد نمیکند، بلکه انسان میتواند با استفاده از دادههای آن، عدالت واقعی را بازتولید کند.

بنابراین، این ابزار زمانی ارزشمند است که انسانها نقش هدایتکننده، ناظر و داور اخلاقی را حفظ کنند: آنها باید تصمیم بگیرند که کدام دادهها مهم هستند، چه معیارهای اخلاقی باید اعمال شوند، و چگونه نتایج الگوریتم با ارزشهای انسانی و اجتماعی همسو شوند. بازتعریف ارزشها در این زمینه به معنای ترکیب تحلیل داده با تفکر انسانی است، نه جایگزینی انسان با الگوریتم. تنها با این تلفیق میتوان عدالت واقعی، انسجام اجتماعی و رعایت پیچیدگیهای انسانی را حفظ و انعطافپذیری هنجارها، شفافیت معیارهای اخلاقی و پذیرش پیچیدگی و ابهام انسانی در تصمیمگیریها را تضمین کرد. از این منظر، مفهوم «بازتعریف ارزشها» در عصر هوش مصنوعی نباید به معنای جایگزینی انسان با داده یا الگوریتم باشد؛ بلکه هوش مصنوعی باید ابزاری برای تقویت عدالت، افزایش دقت تصمیمگیری و حفظ انسجام اجتماعی باشد.

هوش مصنوعی باید ابزاری برای تقویت عدالت، افزایش دقت تصمیمگیری و حفظ انسجام اجتماعی باشد.

تنها با این تلفیق است که فناوری میتواند به عدالت واقعی خدمت کند، نه صرفاً به کارکرد عددی و آماری، و نقش انسانی در بازشناسی و بازتولید ارزشها را نادیده نگیرد.

مثالهای ذکرشده نشان میدهند که ترکیب داده و تأمل انسانی میتواند به توسعهی اقتصادی و فرهنگی عادلانهتر و پایدارتر منجر شود. الگوریتمها میتوانند به شناسایی مناطق محروم کمک کنند و با تخصیص منابع به کسبوکارهای کوچک، عدالت اقتصادی را تقویت کنند، اما تشخیص دقیق نیازها، حمایتهای ویژه و رعایت تنوع انسانی بر عهدهی انسان است. تنها با این تلفیق است که فناوری میتواند به عدالت واقعی و نه صرفاً عددی خدمت کند.

عدالت، هنگامی که به الگوریتم سپرده میشود، تجربهی انسانی نیست؛ عدالت دیجیتال، مرز بین عدد و اخلاق، بین پیشبینی و تصمیم است و در این مرز است که انسان باید بایستد، مکث کند و بپرسد: چه چیزی واقعا ارزشمند و مبتنی بر عدالت است؟